In seiner wenig bekannten Kurzgeschichte "Sally" aus dem Jahre 1953 beschreibt Isaac Asimov in visionärer Weise die Funktionen sowie die Chancen und Risiken selbstständig fahrender Autos. Heute nehmen Fahrerassistenzsysteme dem Lenker immer mehr Aktionen ab und unterstützen ihn in vielfältiger Weise. Das autonome Auto ist schon bald nicht mehr Prototyp, sondern Alltag.

Das autonome Auto wird in Situationen geraten, in denen moralische Fähigkeiten von Vorteil sind. Die einen plädieren für komplexe Fähigkeiten, die anderen für einfache. In der Theorie ist alles denkbar. Für die Praxis spreche ich mich für einfache moralische Maschinen in wenig komplexen Kontexten aus. Für PKW, die beschränkt sind und werden in ihren Möglichkeiten.

Bei der Verbreitung der Roboterautos traten erhebliche Widerstände auf. Der Held der Geschichte, Jacob Folkers, blickt zurück: "Heute erscheint uns das alles selbstverständlich, aber ich kann mich noch an die Zeiten erinnern, als die Gesetze die alten Maschinen von den Autobahnen zwangen und nur noch Automatics zuliessen. Gott, was für ein Aufruhr! Sie nannten es alles Mögliche, von Kommunismus bis Faschismus, aber es leerte die Autobahnen und beendete das Töten, bis sich die Automatics schliesslich durchsetzten." Es spricht einiges dafür, dass dieser Aufruhr Wirklichkeit wird. Die Maschinenstürmer werden auf Hauptstrassen unterwegs sein und auf Parkplätzen. Sie werden autonome Autos entführen und zerstören. Und man wird es ihnen nicht verübeln können.

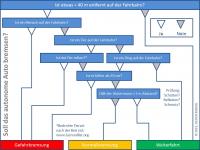

Einer meiner Schwerpunkte ist die Maschinenethik. Mein Interesse gilt der Entwicklung moralischer Maschinen, etwa von besseren Chatbots und besseren Staubsaugern. Die Verbindung von Philosophie, Künstlicher Intelligenz (KI) und Informatik ist faszinierend. Die Forderung nach einem Verkehr, der weitgehend von autonomen Autos bestimmt wird, ist immer häufiger zu hören. Sie ist fast zwangsläufig verbunden mit dem Wunsch nach autonomen Entscheidungen im Technischen, das Moralische betreffend. Damit habe ich als Maschinenethiker noch kein Problem. Ich finde es gut, wenn das Auto in Gefahrensituationen den Insassen aufweckt und warnt. Und wenn es selbstständig abbremst, bei Menschen, die auf der Fahrbahn sind, bei Hirschen, Rehen und Wildschweinen, sogar bei Igeln und Kröten, wenn kein Hintermann zu dicht folgt. Wenn ein Schild vor Krötenwanderungen warnt, bringt das wenig.

Ich bin aber dagegen, dass das Auto, etwa wenn die Bremsen versagen, darüber nachdenken darf, welche Menschen es eliminieren soll und welche nicht. Dass es, mit Hilfe welcher Regeln und Fälle auch immer, sich für das Mädchen entscheidet oder die Gruppe von Kindern. Statt für den Greis und die einsame Frau. In verschiedenen Beiträgen habe ich erörtert, wie man solche Entscheidungen herbeiführen kann. Aus philosophischer und technischer Neugier. Es ist mehr machbar, als sich viele vorstellen können, und man muss nicht mehr zusammenzucken, wenn das scheinbare Unwort der moralischen Maschine fällt. Diese entscheidet sich anders als Menschen, rationaler, radikaler, schneller, aber nicht unbedingt besser. Ohne Zweifel kann sie Leben retten, und eine Automatisierung und Autonomisierung des Verkehrs wird die Zahl der Toten, wie von Asimov erwähnt, weit nach unten drücken. Dennoch bin ich der Meinung, dass wir den PKW in einem eher primitiven Zustand belassen sollten.

Die Moral in der Maschinenethik

Nehmen wir an, die Roboterautos haben die Strassen übernommen. Obwohl der Verkehr viel sicherer geworden ist, kommt es hin und wieder zu Unfällen. Dabei sterben Menschen, die Freunde und Angehörige haben. Diese sind mit der Tatsache konfrontiert, dass die Maschine entschieden hat. Gegen ihren Nächsten, für einen Fremden. Sie werden entweder glauben, dass in Wirklichkeit der Programmierer oder Ingenieur Schicksal gespielt hat, zusammen mit Informatikern, KI-Experten und Maschinenethikern. Oder sie werden denken, dass die Maschine selbst entschieden hat, aufgrund der Regeln, die man ihr beigebracht hat, und aufgrund ihrer Beobachtungen, die durch Kameras und Sensoren ermöglicht werden. Das Auto kommt viel herum und lernt ständig hinzu. In beiden Fällen ist es die Maschine, die den Menschen erfasst, ihn überfährt, ihn zerquetscht. Nicht mehr der Fahrer, der in der Maschine sitzt und diese, ohne es zu wollen, dem Unglück entgegensteuert. Maschine gegen Mensch oder Mensch gegen Mensch, mit dem Mittel der Maschine. Das ist ein enormer Unterschied.

Die Freunde, Partner und Angehörigen werden die Entscheidung nicht immer akzeptieren. Sie werden an ihr zweifeln, auch wenn sie rational getroffen wurde. Sie selbst fällen Urteile nicht immer rational. Ihre Moral ist teilweise angeboren, teilweise erworben. Sie bezieht sich auf Gefühle oder Fakten. Die Mischung macht es, und diese ist allgemein anerkannt. Ein Unfall passiert, und wenn der Verursacher nicht gerade im Vollrausch oder ein Raser war, wird man ihm irgendwann verzeihen. Zumindest wird man verstehen, dass das Unglück passieren konnte. Dem Auto wird man nicht verzeihen, und das hängt zum einen damit zusammen, dass ihm das gleichgültig ist, zum anderen damit, dass es rational entschieden hat. Dass der Nächste gestorben ist, hat angeblich einen guten Grund, war scheinbar eine innere Notwendigkeit. Auch wenn dies so ist, wird man es nicht akzeptieren. Man wird nicht zuletzt an sich selbst denken. Jederzeit kann es einen treffen. Und je älter und einsamer man wird, desto höher dürfte die Wahrscheinlichkeit sein.

Die Maschinenstürmer

In diesem Moment wird der neue Maschinenstürmer geboren. Das Maschinenzeitalter beginnt im 18. Jahrhundert. Schon in der Antike gab es Maschinen aller Art. Aber die Mechanisierung und Automatisierung im grossen Massstab erfasst die Welt erst spät. Die Stürmer zerstörten Maschinen, etwa mechanische Webstühle, und Fabriken. Sie wollten sich dadurch ihre Existenzgrundlage erhalten. Natürlich ohne Erfolg. Erstes Ziel der alten Wirtschaft war die Sicherstellung des Lebensunterhalts. Von der Hand in den Mund und von Hand zu Hand, im Handel und im Tausch. Die moderne Ökonomie erreichte bei den Betroffenen das Gegenteil. Handwerker verloren ihre Arbeit und versanken mit ihren Familien in Armut. Das Roboterauto greift das Leben direkt an. Die Neoautonomen schlagen zurück. Sie werfen Steine von Brücken, hacken sich in Systeme. Sie sind nicht unbedingt technikfeindlich, so wie es der frühere Maschinenstürmer nicht unbedingt war. Sie sind lediglich gegen diese Form der Technik. Auf Parkplätzen demolieren sie Autos und zünden sie an. Ihr Zorn richtet sich auch gegen die Verkehrs-, Sicherheits- und Kommunikationssysteme, das Internet der Dinge.

Ich befürworte solche Taten nicht. Aber ich befürchte, dass wir sie erleben oder selbst ausüben werden. Wenn die Konzepte durchweg richtig wären, könnte man sagen, das erledigt sich von allein. Bis uns "das alles selbstverständlich" erscheint wie in der einstigen Science-Fiction-Geschichte. Allerdings sind die Konzepte nach meiner Meinung in ihrer Mehrheit falsch. Es dürften wirtschaftliche und politische Interessen dahinterstehen, die den Bedürfnissen der Gesellschaft nicht entsprechen. Mein Vorschlag ist, das Roboterauto im Zaum zu halten. Zunächst einmal sollten ihm nur bestimmte einfache Entscheidungen möglich sein. Komplexe Entscheidungen, bei denen Werte bis hin zum Tod von Menschen abgewogen werden, überlässt es denselben. Zudem sollten wir es räumlich und zeitlich beschränken. Spezielle Trassen müssen her. Notfallspuren können umfunktioniert werden. Das Roboterauto darf ausschliesslich zu bestimmten Zeiten fahren. Und nicht mehr als 50, 60 Kilometer in der Stunde. Autonome Lastwagen bilden Kolonnen. Vorneweg ein LKW, in dem ein Mensch das Sagen hat.

Die Moral der Informationsgesellschaft

Neben der Maschinenethik betreibe ich Informationsethik. Während erstere Disziplin nach der Moral der Maschinen fragt, fragt letztere nach der Moral der Menschen, und zwar in der Informationsgesellschaft. Jede Bereichsethik (und die Ethik im klassischen Sinne überhaupt) hat die Moral von Menschen zum Gegenstand. In der Informationsethik diskutiert man die informationelle und persönliche Autonomie. Über Fahrerassistenzsysteme und Roboterautos werden Daten erfasst und weitergegeben. Wenn wir nicht mehr selbst fahren, sind unsere Fehler, Pleiten und Pannen unerheblich. Aber Ausgangspunkt und Zielort nicht, die Gespräche, die wir führen, die Sendungen, die wir sehen. Die feindliche Übernahme von Autos wird thematisiert. Anders als unsere Standrechner und Notebooks sind eingebettete Systeme meist schlecht geschützt. Herzschrittmacher und Roboterautos können attackiert werden − mit fatalen Folgen. Vielleicht wird sich der autonome PKW gar nicht behaupten, weil er zu oft übernommen wird, nicht allein von Maschinenstürmern, die Cracker sind, sondern auch von 14-jährigen Skriptkiddies.

Autorennen als Computerspiele sind out, Autorennen in Vororten in. Mit fremden, ferngesteuerten Wagen, in denen die Insassen schreien und weinen. Um dieses Szenario etwas unwahrscheinlicher zu machen, wäre eine weniger starke Vernetzung hilfreich. Weniger Internet der Dinge, mehr denkende Dinge.

Sally

Wer ist eigentlich Sally? Ein hübsches Auto, in das sein Besitzer Folkers fast verliebt ist. Sally ist nicht nur attraktiv, sie ist frei, geradezu autonom. In ihrer Zeit auf der Farm hat "nie ein menschliches Wesen hinter ihrem Lenkrad gesessen". Sie putzt sich selbst, sie ist aufgeweckt und fröhlich. Manchmal öffnet sie ihre beiden Türen und schlägt sie mit einem Knall wieder zu: "Das ist Sallys Art, zu lachen." Am Ende der Geschichte jagt sie den Schurken, Raymond J. Gellhorn, zusammen mit den anderen Automatobilen, wie sie im Text auch genannt werden. Sogar Automatobusse gibt es: Nicht alle können sich eigene Roboterautos leisten. Am Ende wird Gellhorn von seinem eigenen Bus umgebracht. Der ganze Vorgang erschüttert Folkers: "In letzter Zeit bemerke ich, dass ich selbst Sally meide." In Asimovs Geschichte haben sich die autonomen Autos durchgesetzt. Aber der Autor warnt, so könnte man ihn verstehen, vor den Konsequenzen.

Zum Autor:

Oliver Bendel ist Philosoph und Wirtschaftsinformatiker. Er lehrt und forscht als Professor an der Hochschule für Wirtschaft FHNW mit den Schwerpunkten E-Learning, Wissensmanagement, Social Media, Wirtschaftsethik, Informationsethik und Maschinenethik. Weitere Informationen über www.oliverbendel.net. Die Zitate sind aus: Isaac Asimov. Alle Robotergeschichten. 4. Aufl. Bastei Lübbe, Köln 2012.